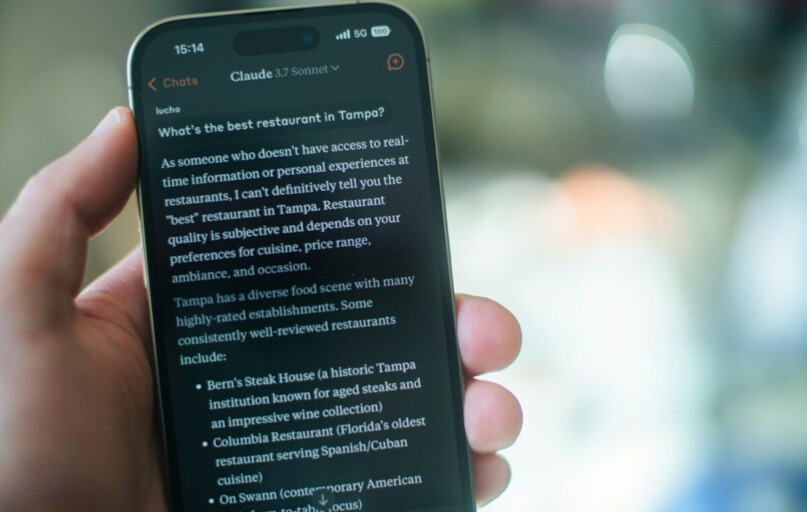

Dirbtinio intelekto pokalbių robotai tampa vis asmeniškesni: jie ne tik analizuoja jūsų žinutes realiuoju laiku, bet ir mokosi iš ankstesnių pokalbių. Bendrovė „Anthropic“ plečia savo DI asistento „Claude“ galimybes ir nemokamiems naudotojams suteikia funkciją, kuri iki šiol buvo prieinama tik mokamo plano vartotojams, – atmintį.

Nuo šiol, pradėdami naują pokalbį su „Claude“, galėsite pasirinkti, ar leisti sistemai remtis ankstesnėmis sąveikomis. Tai padeda tiksliau pritaikyti atsakymus prie jūsų poreikių, rašymo stiliaus, interesų ir darbo įpročių.

Praėjusių metų vasarą „Anthropic“ pirmą kartą įdiegė „Claude“ gebėjimą prisiminti ankstesnius pokalbius. Vėliau, rudenį, atminties funkcija buvo patobulinta: atsirado galimybė geriau atskirti skirtingas temas, naudotojus ir kontekstus. Kitaip tariant, DI gali tiksliau „susisteminti“ sukauptą informaciją ir ateityje ją panaudoti tinkamesnėse situacijose.

Atminties funkcijos išplėtimas į nemokamą planą sutapo su dar viena naujove. Neseniai naudotojams tapo paprasčiau perkelti ankstesnių pokalbių istoriją iš kitų DI asistentų į „Claude“. Tai leidžia greičiau „priprātinti“ naują asistentą prie savo bendravimo manieros ir dažniausiai pasikartojančių temų.

Jei įjungę atmintį vėliau nuspręsite, kad jos nebereikia, galėsite rinktis iš dviejų variantų. Pirmasis – laikinai pristabdyti funkciją, išsaugant sukauptus prisiminimus ateičiai, jei prireiktų ją vėl įjungti. Antrasis – visiškai ištrinti visus sukauptus prisiminimus, kad jie nebebūtų saugomi „Anthropic“ serveriuose.

Šios naujovės pasirodo tuo metu, kai „Claude“ populiarumas sparčiai auga. Programėlė neseniai pakilo į pirmąją vietą nemokamų programų sąraše „App Store“ parduotuvėje. Tai rodo, kad vis daugiau žmonių renkasi „Claude“ kaip kasdienį pagalbininką darbui, kūrybai ir įprastiems klausimams spręsti.

Vis dėlto tuo pačiu metu „Anthropic“ susiduria su rimtais iššūkiais JAV vyriausybės lygmeniu. Šiuo metu vyksta aukšto lygio ginčas dėl sutarties, susijusios su DI saugumo priemonėmis. JAV gynybos sekretorius Pete’as Hegsethas penktadienį „Anthropic“ pavadino „tiekimo grandinės rizika“ po to, kai bendrovė atsisakė pasirašyti sutartį, kuri būtų leidusi Pentagonui naudoti „Anthropic“ modelius masinei amerikiečių stebėsenai ir visiškai autonominiams ginklams.

Po šio pareiškimo „Anthropic“ pranešė sieksianti užginčyti tokį „tiekimo grandinės rizikos“ statusą. Kol kas neaišku, kuo baigsis šis ginčas ir kokią įtaką jis turės tiek pačiai bendrovei, tiek platesnei dirbtinio intelekto ekosistemai, kurioje vis dažniau susikerta technologijų pažanga, nacionalinio saugumo interesai ir etikos klausimai.